小程序蹭聊天机器人流量敛财

![[field:title/] [field:title/]](/images/defaultpic.gif)

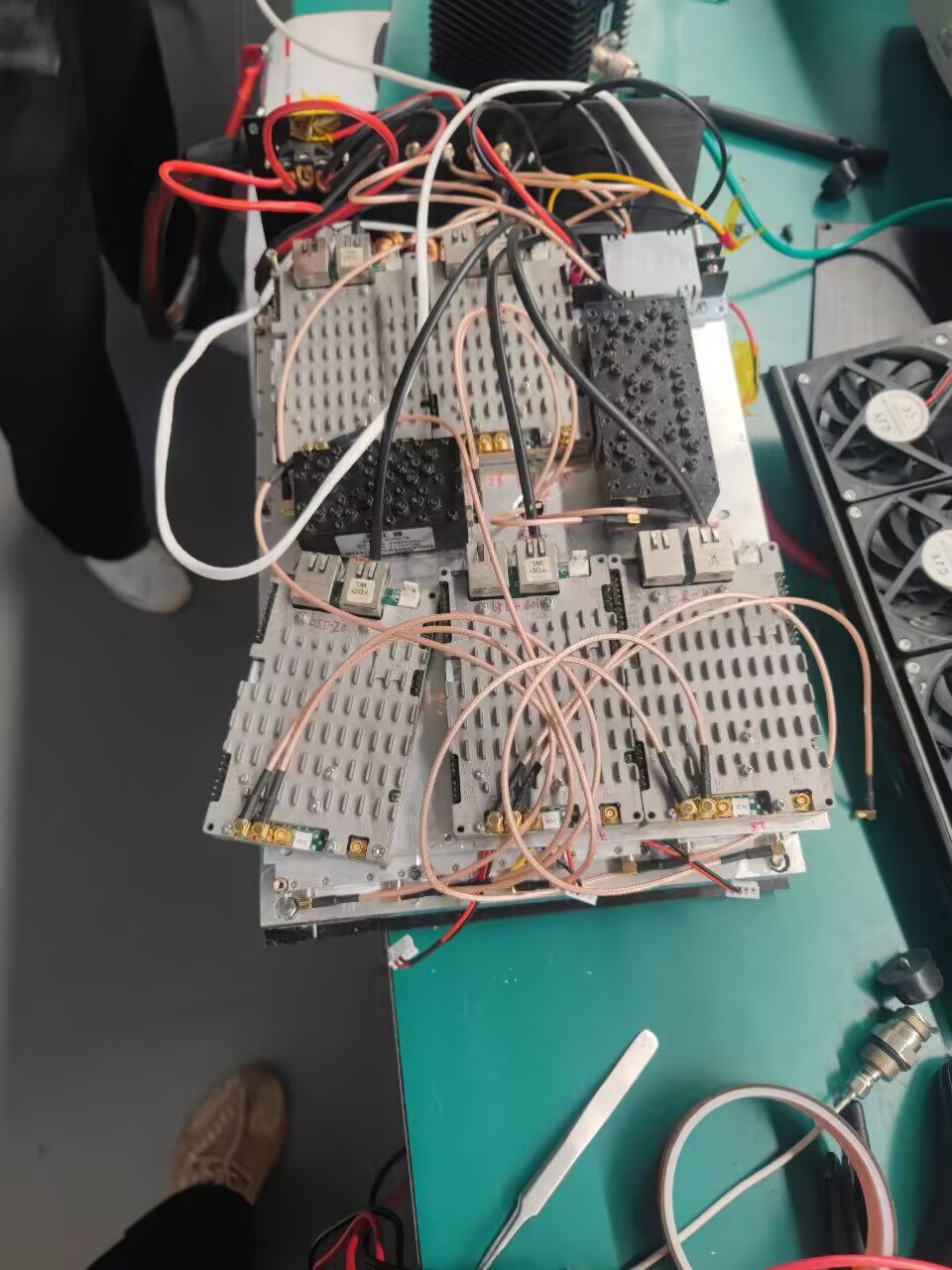

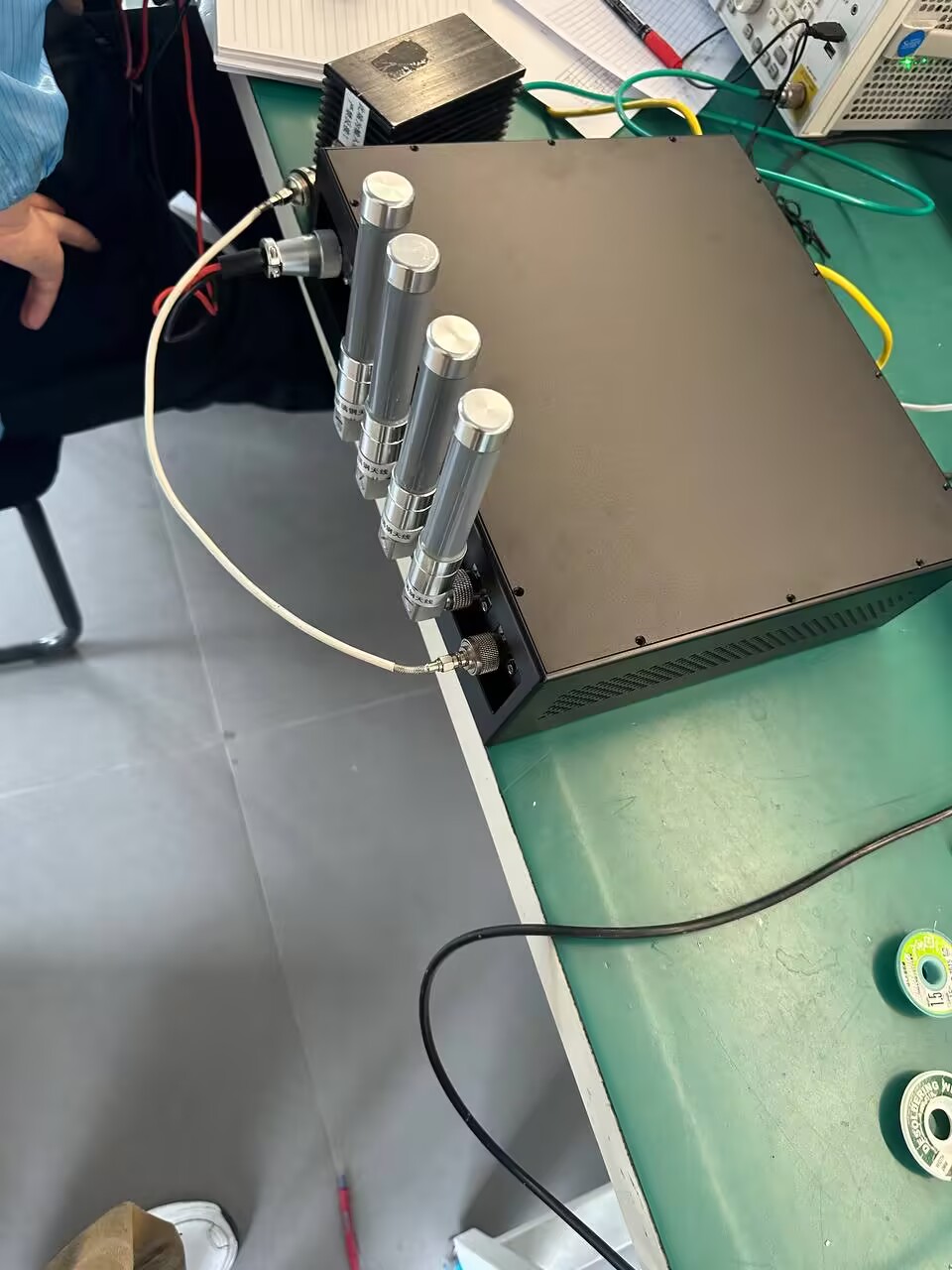

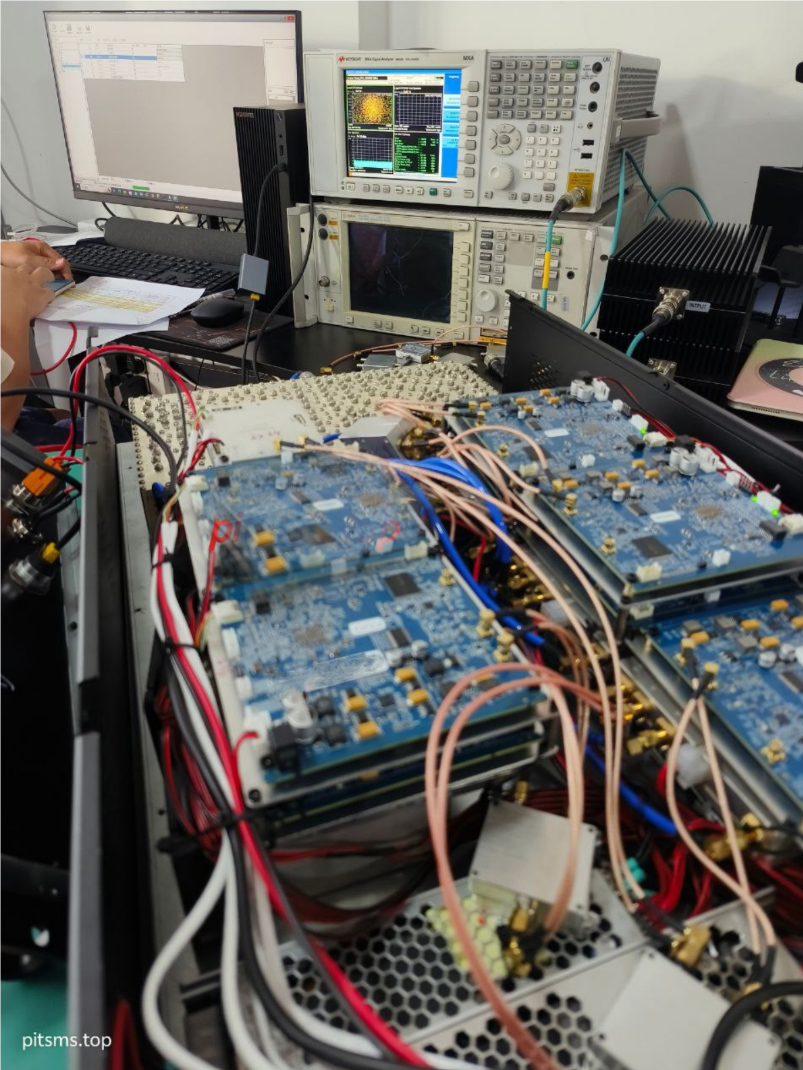

用于2-3-4-5G网络的伪基站设备,我司拥有22年专业定制生产全球短信基站的生产厂家,可按需定制,满足各行各业的活动营销需求,目前已合作马来西亚、泰国、越南、菲律宾、柬埔寨、美国、英国、加拿大、日本、阿联酋、巴西、非洲等30余国家,一次购买,即可享短信终身免费服务。本产品不出售中国大陆地区!!!

近期,ChatGPT(聊天机器人程序)火了,大家认为这是人工智能革命的一大步,与此同时针对ChatGPT使用也出现了一些争议。而一些“李鬼”则看到了商机,借此敛起不法之财。

调查

打着ChatGPT旗号 小程序收费高达千元

ChatGPT走红后,其账号一时在国内多个网购平台、社交平台上销售火热。在某电商平台上售卖成品账号的店铺,一天之内多达万人付款,价格最低2元。北京青年报记者此前曾在某网购平台获取了ChatGPT账号,商家随后私聊发来账号和密码。登录后,记者发现这是一个多人共享账号,系统运行比较缓慢。

商家表示如果需要单人账号则需要额外收费,价格以100元为底价,每多使用1分钟加2元。近日,多个电商平台对销售ChatGPT账号的店铺进行了封禁,相关关键词也被屏蔽。北青报记者先前购买账户的商铺相关商品也已下架。

随着ChatGPT的爆火,国内一些商家嗅到了生意,一批“李鬼”就此出现。一些微信公众号、小程序产品打着ChatGPT的旗号,获取流量,甚至向用户收费,部分账户收费甚至高达千元。实际上,北青报记者了解到,这些“李鬼”通过验证,它们与ChatGPT官方平台回复答案完全不一致。据了解,目前,ChatGPT的开发者、人工智能研究机构OpenAI并没有在中国大陆提供有关ChatGPT的服务,也没有相应的公司运营。

据了解,微信方面封禁了大多数此类相关的小程序和公众号。2月18日下午,北青报记者搜索相关关键词发现,以“ChatGPT”“智能问答”等字眼作名称的小程序已经几乎没有了,但相关的公众号仍然还有不少。其中,一个叫“超级AI问答”的公众号提供5次免费提问机会,超过5次便需要注册会员。该会员的收费为打折后周卡99元,月卡199元,季卡399元。

ChatGPT被诱导用于生成特定网络钓鱼邮件

北青报记者注意到,山寨版的危害可能只是蹭热度、赚流量钱和服务费,更需要提防的,是不法分子把ChatGPT与犯罪行为联系在一起。据公安部官网发布相关信息提醒称,目前,境外有人使用ChatGPT创建一个完整的感染链:不同以往的广撒网式的网络钓鱼,它在提问者的诱导下,可以生成针对特定人或者组织的“鱼叉式”网络钓鱼邮件。此类钓鱼邮件更具有欺骗性和迷惑性,接收者一旦点击该邮件,系统就会被恶意代码感染中毒。

与此同时,不法分子对ChatGPT的恶意利用,也带来了更多的数据安全问题。目前,外国已有相关机构证明该机器人可能被用于编写恶意软件,从而逃避防病毒软件的检测,或利用其拟人的聊天对话功能,冒充真实的人或者组织骗取他人信息等。

案例

使用ChatGPT写作新闻稿 导致错误信息在网上传播

研究机构测试发现,如果对着ChatGPT提出充斥阴谋论和误导性叙述的问题,它能在几秒钟内改编信息,产生大量令人信服却没有来源根据的内容。一旦ChatGPT被不法分子利用,将可能导致ChatGPT衍生成为互联网上制造和传播网络谣言的工具。

2月16日,一则“2023年3月1日起,杭州市政府将取消机动车尾号限行政策,此举旨在提高城市交通效率,缓解交通拥堵,方便市民出行……”的消息在网上疯传。其一板一眼的表达让许多市民都认为这是官方的正式通报。然而实际情况是,杭州某小区业主群讨论ChatGPT,一位业主尝试用它写篇杭州取消限行的新闻稿,随后在群里直播了使用ChatGPT的写作过程,文章发在群里后经其他业主截图转发,导致了错误信息传播。涉事业主后来在群里道歉。

分析

使用ChatGPT具有一定的法律风险

北京京师律师事务所律师雷国亚对北青报记者表示,ChatGPT火了,但其背后暴露出的人工智能法律风险,以及围绕ChatGPT展开的无序商业值得重视。不少人尝试用ChatGPT写论文、研报,甚至写程序等,甚至一些人用来开展商业行为。这些行为目前都具有一定的风险,比如知识产权问题、原创性问题等。如果确实是工作需要,使用ChatGPT写相关内容,必须注明测试,署名时也要标注是ChatGPT。发布者要对自己发布内容的真实性负责,否则将承担相应的法律责任。以杭州将取消机动车尾号限行政策为例,如果该业主没有尽到提醒的义务,造成后果是需要承担一定的责任的。 文/本报记者 朱开云 供图/视觉中国

相关

微软修改必应机器人体验上限 每天50次聊天

2月17日,微软表示,从当日起,必应聊天机器人体验的上限为每天50次聊天,每轮5次对话,一次对话包含用户的提问和必应的回复。这是必应在多次失控后,公司对其人工智能实施的对话限制。

微软称,很长的聊天会话可能会混淆必应中的基本聊天模式,为了解决这些问题,微软实施了一些更改,以帮助集中聊天会话。数据显示,绝大多数人都能在5个回合内找到要找的答案,只有约1%的聊天对话有50条以上的信息。聊天会话达到5个回合后,您会被提示开始一个新的主题。在每个聊天会话结束时,需要清除上下文,这样模型就不会被混淆。

15日,微软公告显示,必应发布7天内,已经有71%的人对AI驱动的答案“竖起大拇指”了。但是,如果聊天时间过久,让它回答15个以上的问题,它就会逐渐暴躁,给出没有用处、或与设计的语气不符的答案。

微软表示,很长的聊天会话会使模型混淆它正在回答的问题,因此我们可能需要添加一个工具,以使您更轻松地刷新上下文,或从头开始。有时,在模型尝试响应时,可能会出现我们设计风格之外的语气。这是一个非常重要的场景,需要大量提示。你们中的大多数人不会遇到它,但我们正在研究如何进行更精细的微调控制。

2月7日,微软推出了整合 ChatGPT-4 的全新必应(Bing)搜索引擎,根据微软企业副总裁兼消费领域首席营销官 Yusuf Mehdi发布的消息,在新版 Bing 上线 48 小时内,已经有超过 100 万申请加入。

文/本报记者 温婧 统筹/余美英

- 2025年伊利内蒙古足球超级联赛打响2025/08/25

- 厉行节约推动学习教育走深走实2025/08/25

- 大青山外绿洇天2025/08/25

- 商路通达谋共赢 贸易涌动拓新局2025/08/25

- “五个十”织就中蒙妇女事业发展新图景2025/08/25

- “坐标——中国现代文学馆馆藏革命文物特展”2025/08/25

- 内蒙古高校陆续迎新生2025/08/25

- 蒙东资源通道白永高速建设进入冲刺阶段2025/08/25

- 第三届北疆多民族语言文学交融共生学术研讨会2025/08/25

- “筑梦未来·活力包头” 第三十三届中日韩青少2025/08/25

- 自治区党委理论学习中心组举行2025年第九次集体2025/08/25

- 自治区十三届政协召开第56次主席会议2025/08/25

- 二亿余元补偿金发放至独立新型储能电站2025/08/25

- 1—7月内蒙古经济运行稳定2025/08/25

- 科技“突围”工程氢能专项启动2025/08/25

- 黄河岸边的幸福经济学2025/08/25

- 市场监管部门多维度保障第五届中蒙博览会公平2025/08/25

- 第十三届能源科学家论坛在包头举行2025/08/25

- 深化国有企业产业工人队伍建设改革2025/08/25

- 内蒙古邮政快递业服务现代化产业体系能力持续2025/08/25

- 内蒙古扎实推进中小学校食堂规范化管理2025/08/25

- 孙绍骋深入土默特左旗哈素海现场指导防汛救灾2025/08/25

- 鍖椾含鐭虫櫙灞卞尯鏂板為庨櫓鐐逛綅鍏甯2022/12/08

- 五个关键词解码七月经济(权威发布)2025/08/18

- 鍥介搧閮戝窞灞锛氭墦閫犻珮閾佸畨鍏ㄩ槻鎶も2025/07/08

- 涓讳骇鍖虹伯浼佹敹璐瓒6300涓囧惃 绉嬬伯鏀惰喘2022/12/02

- 娌跨潃澶ц繍娌崇湅涓鍥斤綔鍙ら煹椋庡竼鏂板湴2023/11/11

- 内蒙古书写经济高质量发展亮丽答卷2023/11/10

- 东方七日谈|育新机开新局,上海激发城市“活2023/10/23

- 特色商圈里品味地道中国年2023/01/27

- 提升基层治理效能 守护百姓幸福家园2024/01/27

- 鍖椾含锛氱洰鍓120鎬ユ晳鐢佃瘽鏃ュ懠鍙閲忕害2022/12/22

- 河北省十四届人大二次会议各项筹备工作已全部2024/01/20

- 2024年西城区节能宣传周启动 将打造一批“零碳楼2024/05/15

- 冰雪狂欢即将上演 丰富活动等你体验2024/02/03

- 鍖椾含椤轰箟鍖烘柊澧炴秹鐤椋庨櫓鐐逛綅鍙戝2022/12/11

- 南京推出8幅地块 起拍总价105.5亿元2024/02/01

- 濂嬪彂鏈変负 鎺ㄥ姩鍟嗗姟楂樿川閲忓彂灞曪紙2023/03/05

- 提升信息收集效率,助力场景化应用落地,请务2023/01/31

- 娴锋穩鍖烘柊鏃朵唬鏂囨槑瀹炶返鎺ㄥ姩鏃ユ椿2023/10/29

- 5年期以上贷款市场报价利率降至3.95%2024/02/22

- 浜娲ュ唨缁忔祹鎬婚噺绐佺牬10涓囦嚎鍏2023/02/23

- 上半年广西有效注册商标总量超58万件2025/08/08

- 广东携超3万个优质岗位赴宁引才2025/04/30